Contents

As interpreters, we’re used to being team players. We don’t like to work alone – whether that be in a booth on-site or remotely from our home offices. Whatever we do, we can trust our favourite people – our booth mates.

So what if we could have an additional mate in our booth? A mate that always listens, never gets tired, knows our glossary better than we do ourselves and takes notes for us? What may sound like magic is possible thanks to technology! For my master’s thesis in the master’s degree program Conference Interpreting at TH Köln, I investigated such a tool – the InterpretBank Artificial Boothmate. I would like to briefly present the tool as well as my small field study in this blog post.

The tool

The functionalities of the InterpretBank Artificial Boothmate (ABM) can be explained quickly. This browser-based software runs on practically every computer, no matter if working remotely or on-site, and listens to the floor audio. Based on that, it can extract pre-defined terms, dates and numerals and show them to me as user. The software acts as a digital boothmate that is noting down important terms and context to support me whilst I am interpreting. As the interpreter, I still have full control over whether, when and how I want to use the different features.

Technical aspects

InterpretBank ABM is currently part of the cloud services included in an InterpretBank supscription. Through a local InterpretBank installation, users receive an individual link to a session that they can open in any web browser. The ABM session is not bound to a single computer. Thanks to the browser-based system, the ABM can be used on any computer connected to the internet, irrespective of its operating system. Additionally, the ABM does not require a specific meeting software. Instead, it can run independently next to software such as Zoom, Teams and other conferencing tools. To fully make use the capabilites of the software, such as recognizing specific terms, the user can upload a personal glossary.

Once a session is opened in the browser, the page is designed in a very simplistic manner. On the left, the tool highlights terminology the user has uploaded before, whereas numerals and dates are displayed on the right. In the top bar, you can set the source language that InterpretBank will recognize. At the time of my field study, only English could be selected as source language. To its right, you can change whether or not you want to see the automatic transcription InterpretBank always performs in the background. The red button next to its starts the tool.

Whilst the browser-based approach has its advantages – no need to install and update additional software, the tool runs on basically any operating system – it also comes with some downsides. One obvious disadvantage is the need for a stable internet connection for the tool to be usable. This may be a no-brainer for remote assignments, but it’s not always a given for on-site jobs. InterpretBank ABM requires an internet connection as it uses Google’s Speech-to-text API for speech recognition. It’s also not completely transparent what happens with the data on Google’s servers. The user must be aware of this when handling sensitive data.

Browsers on the other hand have long been equipped with mechanisms to keep websites from accessing users’ cameras and microphones. For InterpretBank to work, these mechanisms need to be disabled by the user. Additionally, remote assignments require specific settings to enable the ABM to listen to the computer’s audio (a manual for the participants of my study just for these settings spanned almost four pages). In general, I can only recommend every potential user to set up and try out the tool before an assignment. This is due to the fact that PCs typically use different sound cards and drivers which may change the settings menu to a degree that the setup manual provided by InterpretBank won’t be of any use.

On-the-job experience

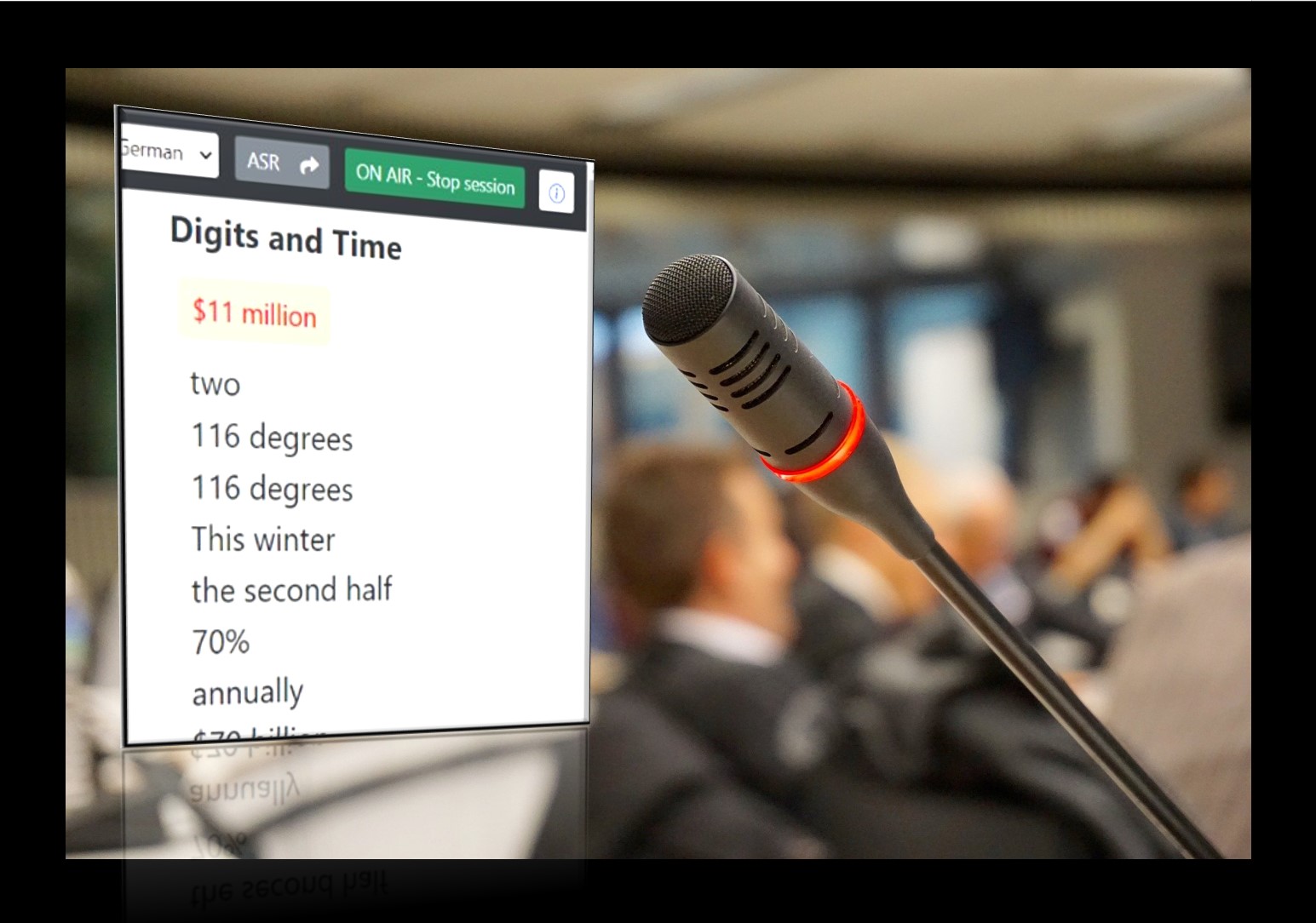

Let’s now get into the live experience: I’ve opened an InterpretBank session in my web browser in addition to any other open windows. I’ve chosen all the right settings and the tool is active, as can be seen by the green “ON AIR” button. The digital boothmate is diligently noting down numerals and dates. New notes will be marked in red and placed at the top of the page before “sliding” down after some time has passed, thus creating a theoretically infinite list of speech content.

InterpretBank can display not only numerals, but also some of the most common units of measurement, which can be quite helpful. In the picture on the left, we can see for example dollar and percentage signs as well as “degrees” after the numbers. For numbers that rapidly follow one another, this can provide helpful context.

During longer pauses or if no sound reaches the software, the tool may automatically deactivate. When that happens, the start button simply needs to be clicked again. In theory, this isn’t a huge deal, but in the heat of the moment, you might be quick to overlook that your tool is inactive and wonder why it isn’t working.

My field study

Now that we know how the tool works, let’s talk about what it’s like to actually use it.

For my field study I asked interpreters to interpret two speeches by US President Joe Biden. One speech was interpreted with the support of InterpretBank ABM, the other without. Afterwards I analysed if their rendition of numerals was more accurate whenever they were using the ABM. I limited the analyzation to numerals since their correct rendition is one of the most challenging tasks when interpreting, and their correct interpretation is easy to assess. Glossaries, in contrast, are a very individual factor of interpreting performance, which would’ve made a comparison difficult. The results of the field study are presented in the following chart:

[Teilnehmer – participant; Exakter Wert – exact value; Substitution – substitution; Rundung – rounding; Approximierung – approximation; fehlerhafter Wert – incorrect value; mit ASR-Unterstützung gedolmetsche Rede – speech interpreted with ASR support]

When we look at the results, we see that there are some participants who’ve interpreted numerals better when working with the ABM. On the other hand, there are some that couldn’t find any use in the software and considered it more of a nuisance, which is why we can’t see an improvement in their interpretation. However, it it could be argued that this is very similar to the way we behave in the booth – some colleagues don’t want their booth mates to note down any terminology or numerals and choose to ignore them when they do so, while the opposite may be the case for others. In general, the bottom line could be: Each to their own. Right?

But then the study gets more interesting when looking at the comments the participants sent me after the study, before knowing their results. Participants that were already facing technical difficulties during the setup on their computer reported mistrusting the software. They were sure that they had understood numerals correctly that had been displayed wrongly or not at all by the ABM.

I would like to highlight that whilst the participants had been instructed on how to use the software, none of them had any prior experience or training with it. They needed to find out on their own how they could work with the tool. In my opinion, in-depth training and instructions on how tools like the ABM can change an interpreters’ workflow are critical to making things work.

Conclusion

Interpreting is a highly individual process. You will be hard pressed to find two interpreters working in exactly the same way. That’s because every interpreter is working with their own set of tools – be it their own memory, a notepad, or a booth mate. CAI software such as the InterpretBank ABM is just another tool in the box. If used correctly, it may very well simplify your workflow – but just like if it’s your first time working with a chain saw, you may also find yourself giving up on using it out of frustration very quickly.

As to InterpretBank ABM as a tool, I can say that there are advantages and disadvantages to it On the one hand it is easy to use (once set up) and doesn’t have outlandish system requirements. It’s compatible with every conference tool and can be integrated into the booth workflow easily. On the other hand, users need a certain degree of technical understanding of their computers to set up the software. Additionally, InterpretBank ABM isn’t a fully integrated interpreting platform with handover and conferencing functionalities. Other products in development offer a more wholistic approach. Of course, it is obvious that an ABM system can in no way replace a human booth mate. Rather, it can be an “additional” partner that I can tailor to fit my own personal needs.

The technology behind it will definitely evolve and has come to stay.

++++++ Und nun auf Deutsch 🙂 ++++++

Als Dolmetscher:innen sind wir Teamplay gewöhnt. Wir arbeiten ungern allein, ob in einer Kabine vor Ort oder in Remote-Einsätzen im eigenen (Heim-)Büro. Verlassen können wir uns immer auf unsere Lieblingsmenschen beim Dolmetschen – unsere Kabinenpartner!

Was wäre also, wenn man sich einfach noch einen weiteren Partner in die Kabine holen könnte? Einen, der stets zuhört, nicht müde wird, mein Glossar besser kennt als ich selbst und für mich fleißig Notizen macht? Klingt nach Magie, ist aber mit moderner Technologie möglich. Für meine Masterarbeit im Master Konferenzdolmetschen der TH Köln habe ich mich mit einem solchen Tool auseinandergesetzt, dem InterpretBank Artificial Boothmate. Das Tool sowie meinen kleinen Feldversuch möchte ich in diesem Blogbeitrag kurz vorstellen.

Das Tool

Was der InterpretBank Artificial Boothmate (ABM) kann, ist im Grunde schnell erklärt. Die browserbasierte Software läuft auf quasi jedem Computer und kann bei Einsätzen, egal ob remote oder vor Ort, den Sprecherton mithören und basierend darauf vordefinierte Terme, Zeitangaben und Numeralien extrahieren und mir als Benutzer anzeigen und hervorheben. Die Software dient mir so als digitaler Kabinenpartner, der für mich wichtige Begriffe und Kontexte mitnotiert. Ich als Dolmetscher habe weiterhin freie Handhabe, ob, wann und wie ich diese Begriffe in meiner Verdolmetschung verwende.

Technische Aspekte

InterpretBank ABM ist aktuell Teil der Cloud Services, auf die man mit einem aktiven InterpretBank-Abo Zugriff erhält. Über eine lokale InterpretBank-Installation erhält man einen individuellen Link zu einer Session, der im Internetbrowser eingegeben werden kann. Die ABM-Sitzung ist dabei nicht an einen bestimmten Computer gebunden. Dank der browserbasierten Lösung kann auf jedem internetfähigen Laptop oder Computer nahezu unabhängig vom verwendeten Betriebssystem die ABM-Software genutzt werden. Auch ist das Tool so an keine bestimmte Videokonferenz-Software gebunden, sondern kann als Extra-Software neben Zoom, Teams und allen bekannten Online-Meeting-Tools weiterlaufen. Für eine volle Nutzung aller Fähigkeiten der Software (Sprich: Erkennung von Termini) kann ein persönliches Glossar hochgeladen werden.

Habe ich einmal eine Session im Browser geöffnet, ist die Seite grundsätzlich sehr einfach gehalten. Links wird von mir persönlich hochgeladene Terminologie hervorgehoben, während rechts Zahlen und Daten angezeigt werden. In der oberen Leiste kann noch die Ausgangssprache, die InterpretBank erkennt, eingestellt werden. Zum Zeitpunkt meiner Masterarbeit war diese jedoch auf Englisch begrenzt. Rechts daneben kann eingestellt werden, ob ich die automatische Transkription von InterpretBank sehen möchte oder nicht. Die rote Schaltfläche daneben startet das Tool.

Während das browserbasierte System einige Vorteile mit sich bringt, wie beispielsweise dass keine gesonderte Software installiert und aktuell gehalten werden muss und das Tool grundsätzlich auf allen Betriebssystemen funktioniert, so bringt es auch einige Nachteile. Der offensichtlichste ist natürlich, dass eine konstante Internetverbindung erforderlich ist, um das Tool nutzen zu können. Für Anwender:innen, die remote zugeschaltet sind, ohnehin ein No-Brainer – für Kolleg:innen vor Ort jedoch nicht immer gegeben. Über besagte stabile Internetverbindung nutzt InterpretBank ABM die Speech-To-Text-API von Google zum Erkennen von Gesprochenem. Was mit den Daten auf den Google-Servern passiert, ist nicht komplett nachzuvollziehen. Mit sensiblen Daten sollte hier vorsichtig umgegangen werden.

Benutzerseitig sind in Browsern längst Mechanismen eingebaut, um datenhungrigen Websites den Zugriff auf Kamera und Mirkofon zu erschweren. Diese müssen für InterpretBank ABM händisch ausgehebelt werden. Darüber hinaus bedarf es besonders in Remote-Situationen einer besonderen Konstellation von Einstellungen, um dem ABM das Zuhören des Audios zu ermöglichen (eine Anleitung für Versuchsteilnehmer:innen in meiner Masterarbeit umfasste allein hierfür knapp vier Seiten). Grundsätzlich sei daher allen Interessierten geraten, das Tool vor einem Einsatz zunächst zuhause aufzusetzen und auszuprobieren. Denn Computer verfügen klassischerweise über verschiedene Soundkartensysteme sowie zugehörige Treiber, die das Handling unter Umständen so verändern können, dass die von InterpretBank zur Verfügung gestellte Anleitung hinfällig wird.

Während des Dolmetschens

Gehen wir nun also in eine konkrete Dolmetschsituation. Ich habe neben welchen Fenstern auch immer auf meinem Computer auch ein Browserfenster mit dem InterpretBank ABM offen. Alle Einstellungen habe ich richtig vorgenommen und das Tool ist aktiviert, wie an der grünen Schaltfläche zu erkennen ist, auf der „ON AIR“ steht. Der digitale Kabinenpartner schreibt mir fleißig Zahlen und Datumsangaben auf. Neue Angaben werden markiert und in rot an erster Stelle präsentiert und „rutschen“ nach einer Zeit nach unten. So entsteht eine theoretisch endlose Liste mit allen Angaben, die in einer Rede vorkamen.

Äußerst hilfreich kann dabei sein, dass nicht nur Zahlen, sondern auch einige der häufigsten Einheiten angegeben werden. Im Bild links sehen wir so beispielsweise Dollar- und Prozentzeichen sowie den Zusatz „degrees“ bei zwei Zahlen. Gerade bei schnell aufeinanderfolgenden Zahlen kann dies eine zusätzliche Hilfe für die Einordnung darstellen.

Bei längeren Redepausen oder wenn kein Ton mehr die Software erreicht, kann es vorkommen, dass sich das Tool automatisch deaktiviert. Dann muss einmal kurz die Schaltfläche zum Starten erneut gedrückt werden. Eigentlich kein großer Aufwand, aber in der Kabine kann das durchaus schnell vergessen werden und man wundert sich, warum die Software nicht „funktioniert“.

Meine Untersuchung

So viel also zur Funktions- und Arbeitsweise des Tools. Doch wie fühlt es sich nun tatsächlich an, mit der Software zu arbeiten?

Für meine Feldstudie wurden Dolmetscher:innen aufgefordert, zwei Reden von US-Präsident Joe Biden zu dolmetschen. Bei jeweils einer davon sollten sie mit Unterstützung des Tools arbeiten, bei der anderen ohne. Bei einer Auswertung wurde überprüft, ob sich die Wiedergabe der Zahlen bei Unterstützung durch den digitalen Kabinenpartner verbesserte. Die Beschränkung auf Zahlen ergibt sich aus der einfachen Tatsache, dass deren korrekte Wiedergabe weithin als eine der schwierigsten Aufgaben beim Dolmetschen gilt und zudem die korrekte Wiedergabe einfach zu überprüfen ist. Die Ergebnisse sind in der nachfolgenden Grafik dargestellt:

Sieht man sich die Ergebnisse der Studienteilnehmer:innen an, fällt auf, dass es durchaus Teilnehmer:innen gibt, die mit Unterstützung exakter gearbeitet haben. Gleichzeitig gibt es jedoch auch solche, die mit der Arbeit der Software wenig anfangen konnten und sie eher als störend empfanden, weswegen man keine Verbesserung der Dolmetschleistung feststellen kann. Hier lassen sich Parallelen ziehen zu Dolmetschsituationen in der Kabine – einige Kolleg:innen möchten schlicht nicht auf etwaige Notizen der Kabinenpartner:innen hingewiesen werden und empfinden diese als störend, für andere ist das Gegenteil der Fall. Das grundsätzliche Fazit hier könnte also einfach sein: Jeder nach seiner Façon. Oder?

Spannender werden die Ergebnisse, wenn man sie mit den persönlichen Kommentaren abgleicht, die die Studienteilnehmer:innen nach Durchführung der Studie (ohne dabei ihre Ergebnisse zu kennen) geäußert haben. Teilnehmer:innen, die bereits bei der Einrichtung auf ihren eigenen Computern technische Probleme zu haben schienen, berichteten nach der Durchführung, dass sie der Software gegenüber misstrauisch seien und sie sich sicher seien, dass sie Zahlen korrekt verstanden, aber falsch angezeigt gesehen hätten, oder dass einige Zahlen gar nicht angezeigt worden seien.

Hervorzuheben ist auch, dass die Teilnehmer:innen zwar eine Einweisung in die Funktionsweise des Tools erhalten hatten, allerdings niemand von ihnen Vorerfahrung mit dem Umgang des Tools hatte. Wie mit dem Tool zu arbeiten ist, haben die Teilnehmer:innen also für sich selbst herausfinden müssen. Eine ausführliche Unterweisung und Training in der Arbeitsweise halte ich für das Anwenden neuer Technologie für unabdingbar.

Fazit

Das Dolmetschen ist ein höchst individueller Prozess. Man wird sich schwertun, zwei Dolmetscher:innen zu finden, die ihre Arbeit auf die exakt selbe Art und Weise ausfüllen. Dafür hat jede:r Dolmetscher:in einen eigenen Werkzeugkoffer – das eigene Gedächtnis, einen Notizblock oder Kabinenpartner etwa. Unterstützungsprogramme wie der InterpretBank AMB sind ein weiteres Werkzeug in diesem Koffer. Richtig angewendet und mit Übung können Prozesse vereinfacht werden – wer jedoch zum ersten Mal ohne Einweisung eine Kreissäge bedient, wird sich auch schnell frustriert abwenden.

Zu InterpretBank ABM selbst ist zu sagen, dass das Tool einige Vor- und Nachteile mit sich bringt. Einerseits ist es (wenn es einmal eingerichtet wurde) relativ einfach zu bedienen und bringt quasi keine besonderen Systemvoraussetzungen mit sich. Es ist mit jeder Konferenzsoftware kompatibel und kann auch einfach mit in die Kabine genommen werden. Andererseits fordert die technische Initialisierung von den Nutzer:innen etwas Verständnis. Außerdem ist InterpretBank ABM keine vollständig integrierte Dolmetschlösung mit Übergabe- oder Meetingfunktionen. Indiskutabel ist, dass das ABM-System einen menschlichen Kabinenpartner mitnichten ersetzen kann. Vielmehr ist er ein „zusätzlicher“ Partner, den ich aber stark auf meine individuellen Bedürfnisse zuschneiden kann.

Die zugrundeliegende Technik wird sich auf jeden Fall weiterentwickeln und ist gekommen, um zu bleiben.

Further Reading

Defrancq, Bart/Fantinuoli, Claudio 2021. Automatic speech recognition in the booth. Assessment of system performance, interpreters’ performances and in-teractions in the context of numbers. Target. International Journal of Transla-tion Studies 33 (1), 73–102. https://doi.org/10.1075/target.19166.def.

Defrancq, Bart 2021. Ergonomics of the Artificial Boothmate (EABM), #SCIC25: The 25th SCIC Universities Conference, 03.12.2021. Online verfügbar unter https://webcast.ec.europa.eu/scic-universities-conference-2021-12-03

Fantinuoli C., Marchesini G., Landan D., Horak L. 2022. Interpreter Assist: Fully-automated real-time support for Remote Interpretation”. In: Proceedings of Translator and Computer 53 Conference. https://doi.org/10.48550/arXiv.2201.01800

Fritella, Francesca Maria 2022. CAI tool-supported SI of numbers: A theoretical and methodological contribution. International Journal of Interpreter Education 14 (1), 32-56. Online verfügbar unter https://tigerprints.clemson.edu/cgi/viewcontent.cgi?article=1209&context=ijie.

Frittella, Francesca Maria 2023. Usability research for interpreter-centred technology: The case study of SmarTerp. Language Science Press. Online verfügbar unter https://library.oapen.org/bitstream/handle/20.500.12657/63279/1/external_content.pdf.

Leave a Reply