Tag: interpreting

-

Professional ethics – do they need future-proofing? On the art of telling things apart

Intro Discussions about professional ethics in conference interpreting have lately struck me as rather unsatisfactory. Can we impose our European fees on colleagues from different continents when working remotely? Can I do two assignments in one day? Can I just switch on my Computer-Aided Interpreting tools in the booth and have AI listen to the…

-

AI-made podcasts by NotebookLM and Jellypod

AI generated podcasts – are they any good for meeting preparation, or for conference interpreter training? My student Rebecca Bremer, a real podcast aficionado, wanted to find out and did some testing. Here’s what she has found out: Guest article by Rebecca Bremer, student of conference interpreting at TH Köln General considerations Podcasts have become…

-

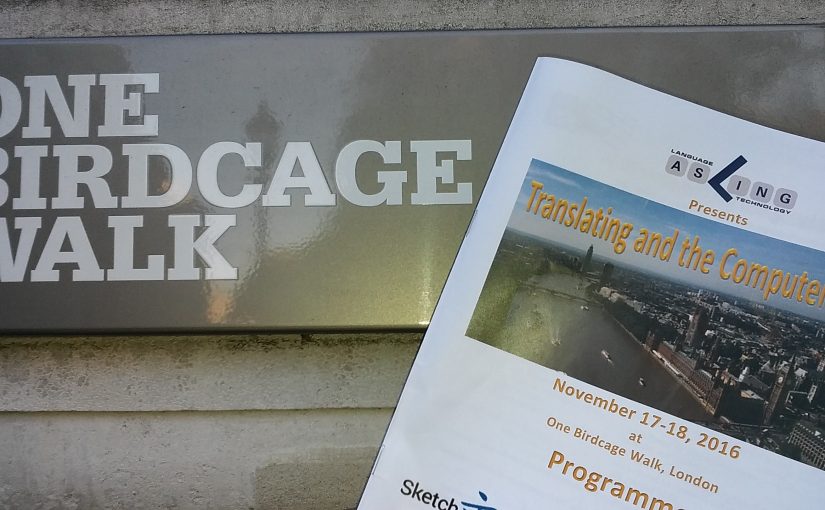

Interpreting and the Computer – finally a happy couple?

This year’s 39th edition of the Translating and the Computer conference, which Barry Olsen quite rightly suggested renaming to Translating and Interpreting and the Computer :-), had a special focus on interpreting, so obviously I had to go to London again! And I was all the more looking forward to going there as – thanks…

-

Simultaneous interpreting with VR headset | Dolmetschen unter der Virtual-Reality-Brille | Interpretación simultanea con gafas VR

+++ for English see below +++ para español, aun más abajo +++ 2016 wurde mir zum Jahresausklang eine Dolmetscherfahrung der ganz besonderen Art zuteil: Dolmetschen mit Virtual-Reality-Brille. Sebastiano Gigliobianco hat im Rahmen seiner Masterarbeit am SDI München drei Remote-Interpreting-Szenarien in Fallstudien durchgetestet und ich durfte in den Räumen von PCS in Düsseldorf als Probandin dabei…

-

Impressions from Translating and the Computer 38

The 38th ‘Translating and the Computer’ conference in London has just finished, and, as always, I take home a lot of inspiration. Here are my personal highlights: Sketch Engine, a language corpus management and query system, offers loads of useful functions for conference preparation, like web-based (actually Bing-based) corpus-building, term extraction (the extraction results come…

-

Dictation Software instead of Term Extraction? | Diktiersoftware als Termextraktion für Dolmetscher?

+++ for English see below +++ Als neulich mein Arzt bei unserem Beratungsgespräch munter seine Gedanken dem Computer diktierte, anstatt zu tippen, kam mir die Frage in den Sinn: “Warum mache ich das eigentlich nicht?” Es folgte eine kurze Fachsimpelei zum Thema Diktierprogramme, und kaum zu Hause, musste ich das natürlich auch gleich ausprobieren. Das…

-

In the booth or in the hen house – experts all around | Dolmetschkabine oder Hühnerstall – Expertentum, wohin man schaut | Entre expertos: ya sea en el gallinero o en la cabina de interpretación

+++ for English see below +++ para español, aun más abajo +++ Wie inspirierend der Bau eines Hühnerhäuschens sein kann, erschließt sich eventuell nicht auf den ersten Blick. Wer im Laufe der letzten Monate die Kabine mit mir teilen und meine Hühnerfotos bewundern musste, fragt sich aber vielleicht schon seit Längerem, wann die Hennen denn…